百度开源 ERNIE-Image:8B 参数的文生图模型,凭什么在开源圈拿第一?

说句大实话,AI 画图这件事,大家早就见怪不怪了。

Midjourney 画得好、Stable Diffusion 能魔改、FLUX 又快又稳——好像该有的都有了。但有一个问题,几乎所有做设计的人都踩过坑:AI 生成的图片里,文字几乎都是乱码。

海报上应该写“新品上市”,出来的是一坨外星符号。漫画对话框里该有台词,结果全是鬼画符。中英混排?别想了,直接翻车。

直到昨天(4 月 15 日),百度正式开源了 ERNIE-Image,一个只有 8B 参数的文生图模型,在多个公开基准测试中拿了开源第一。更关键的是——它的文字渲染能力,终于像样了。

一、ERNIE-Image 到底是什么?

ERNIE-Image 是百度文心团队开发的 开源文生图模型,基于单流 Diffusion Transformer(DiT)架构,核心参数量只有 8B(80 亿)。

说白了,它的工作方式和大多数 AI 画图模型一样:你输入一段文字描述,它帮你生成一张图片。

但它有几个不一样的地方。

💡 核心概念:ERNIE-Image = 单流 DiT(负责画图)+ Prompt Enhancer(负责理解你的意思)+ 8B 参数(体量小但能打)

两个版本:

| 版本 | 推理步数 | CFG | 特点 |

|---|---|---|---|

| ERNIE-Image | 50 步 | 4.0 | SFT 版,质量更高,指令更精准 |

| ERNIE-Image-Turbo | 8 步 | 1.0 | 蒸馏加速版,速度快 6 倍,美学更强 |

Turbo 版用了 DMD(分布匹配蒸馏)+ RL(强化学习)两种技术加速,从 50 步压缩到 8 步,速度提升近 6 倍。

二、为什么它值得关注?

目前开源文生图模型的竞争格局大概是:

- FLUX.2-klein(9B):综合能力强,但中文文字渲染不行

- Z-Image(6B):阿里通义出品,写实风格强,但文字细节有瑕疵

- Stable Diffusion 3.5(8B):生态最成熟,但文字始终是短板

- Qwen-Image(7B):阿里出品,语义理解好,文字渲染一般

ERNIE-Image 的独特定位在于:它把“可控性”放在了和“美观度”同等重要的位置。

💡 一句话总结:别的模型在追求“画得好看”,ERNIE-Image 还在追求“画得对不对”。

它的 6 大核心特点:

- 精确文字渲染:中英文混排、密集长文本、排版敏感文字都能搞定

- 复杂指令跟随:多物体、多关系、知识密集型描述都能准确执行

- 结构化图像生成:海报、漫画分镜、多面板构图特别擅长

- 风格覆盖广泛:写实摄影、平面设计、电影质感都能来

- 紧凑但能打:8B 参数,性能却比很多更大的模型还强

- 消费级部署:24GB 显存就能跑,4090、RTX 3090 都行

三、它是怎么做到的?

先打个比方。

想象你要让一个画师画一张海报。大多数 AI 模型就像一个“急性子画师”——你还没说完要求,他就开工了,结果画出来的东西跟你想象的不太一样。

ERNIE-Image 更像是一个“有翻译的画师”。

你说的中文指令,先经过 Prompt Enhancer(提示词增强器) 这个“翻译官”,被扩展成一段更详细、更有结构的描述。然后画师再根据这份详尽的“翻译稿”开工。

这样出来的效果,自然更精准。

📖 技术解释:ERNIE-Image 采用单流 DiT 架构,把文本 token、视觉语义 token 和图像 VAE token 融合成统一序列处理。配合轻量级 Prompt Enhancer,将用户的简短输入扩展为更丰富的结构化描述,从而提升生成质量。

关于 Prompt Enhancer(PE):

这是 ERNIE-Image 的一个亮点设计。它是一个轻量级模型,负责把你随口说的“画个海报”自动扩展成包含构图、色彩、文字内容、排版方式等细节的专业级提示词。

从 benchmark 数据看,开启 PE 后,模型在文字渲染(LongTextBench)和指令跟随(GENEval)上都有明显提升。

四、成绩单怎么样?

数据说话。在四个主流基准测试上,ERNIE-Image 的表现:

- GENEval(组合生成能力):ERNIE-Image 以 0.8856 的综合得分排名第一,超越 Qwen-Image(0.8683)、FLUX.2-klein-9B(0.8481)、Z-Image(0.8400)。

- LongTextBench(长文本渲染):ERNIE-Image(w/ PE)以 0.9733 排名第二(仅次于闭源商业模型 Seedream 4.5 的 0.9882),远超 FLUX.2-klein-9B(0.5413)。

- OneIG-EN / OneIG-ZH(开放域图像生成):在英文和中文维度上,ERNIE-Image 都稳居开源模型前列。

⚠️ 注意:FLUX.2-klein-9B 的 LongTextBench 中文得分只有 0.2183,这意味着它在生成包含中文的长文本时几乎不可用。这也是 ERNIE-Image 相对 FLUX 的最大优势。

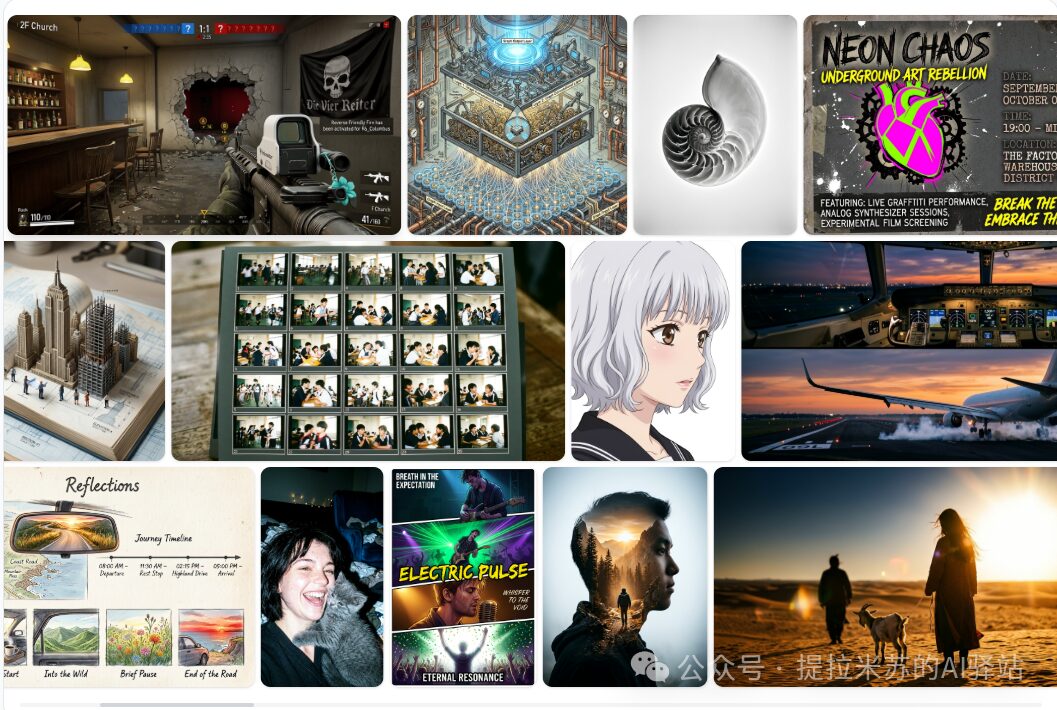

五、实际效果怎么样?

根据官方展示和第三方评测,ERNIE-Image 在以下场景表现突出:

- 海报和设计排版:不只是画个“像海报的图”,而是能准确放置标题、副标题、正文,保持合理的层次和排版。这在开源模型中相当少见。

- 漫画和分镜:不只是画角色,而是能生成完整的漫画页面——有面板分隔、动作连贯、场景过渡,读起来像真正的漫画而不是散装的插画。

- 多面板视觉表达:可以生成四格漫画、对比图组、情绪连贯的系列画面,帧间一致性不错。

- 多语言文字渲染:中英文都能准确渲染,包括密集段落、标题排版、标注文字、漫画台词等。中英混排也没问题。

- 电影质感和艺术风格:不只有高饱和度的“AI 感”,还能做出低饱和电影色调、胶片颗粒感、情绪化光线等更具辨识度的风格。

六、怎么用?

硬件要求:

- 24GB 显存的消费级 GPU(RTX 3090 / 4090 即可)

- 支持 bfloat16 精度

**支持分辨率:**1024×1024、848×1264、1264×848、768×1376、896×1200、1376×768、1200×896

方式一:Diffusers(推荐新手)

import torch

from diffusers import ErnieImagePipeline

# 使用 ERNIE-Image(高质量,50 步)

pipe = ErnieImagePipeline.from_pretrained(

"baidu/ERNIE-Image",

torch_dtype=torch.bfloat16,

).to("cuda")

image = pipe(

prompt="一只黑白相间的中华田园犬在草地上奔跑",

height=1024,

width=1024,

num_inference_steps=50,

guidance_scale=4.0,

use_pe=True # 开启提示词增强

).images[0]

image.save("output.png")

想更快?换成 Turbo 版,只需把模型名和步数改一下:

pipe = ErnieImagePipeline.from_pretrained(

"baidu/ERNIE-Image-Turbo",

torch_dtype=torch.bfloat16,

).to("cuda")

image = pipe(

prompt="一只黑白相间的中华田园犬在草地上奔跑",

height=1024,

width=1024,

num_inference_steps=8, # 只需 8 步

guidance_scale=1.0,

use_pe=True

).images[0]

方式二:SGLang(适合部署服务)

git clone https://github.com/sgl-project/sglang.git

sglang serve --model-path baidu/ERNIE-Image-Turbo

curl -X POST http://localhost:30000/generate \

-H "Content-Type: application/json" \

-d '{

"prompt": "一只黑白相间的中华田园犬在草地上奔跑",

"height": 1024,

"width": 1024,

"num_inference_steps": 8,

"guidance_scale": 1.0,

"use_pe": true

}' \

--output output.png

方式三:ComfyUI

最新版 ComfyUI 已支持 ERNIE-Image,工作流模板可在官方 GitHub 找到。

方式四:在线体验

不想本地部署?可以直接在线试玩:

- HuggingFace Demo:https://huggingface.co/spaces/baidu/ERNIE-Image-Turbo

- 百度 AI Studio:https://aistudio.baidu.com/ernieimage

七、和其他模型比,选哪个?

说下我的看法。如果你在做选型决策,可以参考这个简单判断:

| 你的需求 | 推荐 |

|---|---|

| 中文海报、设计排版 | ERNIE-Image(文字渲染最强) |

| 追求极致画质和风格多样性 | FLUX.2 或 Midjourney |

| 需要大量 LoRA 生态和插件 | Stable Diffusion 3.5 |

| 实时生成、速度优先 | ERNIE-Image-Turbo(8 步出图) |

| 想魔改和微调 | ERNIE-Image(支持 Unsloth GGUF + AI-Toolkit 微调) |

💡 我的观点:ERNIE-Image 并不是要在所有维度上碾压对手,而是在 中文场景的实用性 上迈出了一大步。对于做电商设计、社交媒体运营、内容创作的中国用户来说,“图里文字写对了”比“图更好看了一点点”重要得多。从这个角度看,ERNIE-Image 的开源意义,不亚于国产大模型在语言领域的突破。

八、值得关注的技术趋势

ERNIE-Image 的发布,其实折射出一个重要趋势:文生图模型正在从“画得好看”转向“画得可控”。

2024 年大家还在比谁画得更逼真,2025 年比谁跑得更快、参数更少,到了 2026 年,可控性成了新的竞争焦点。

几个值得关注的信号:

- 文字渲染成为标配能力:ERNIE-Image、Z-Image、LongCat-Image 都在重点攻克这个方向,说明业界已经意识到这是 AI 画图落地的关键瓶颈。

- 蒸馏加速成为标配:ERNIE-Image-Turbo(DMD+RL)、Z-Image-Turbo(Decoupled-DMD),大模型蒸馏成小模型已经是主流路线。

- 单流架构成趋势:从双流设计(文本和图像分开处理)转向单流 DiT,ERNIE-Image、Z-Image、Qwen-Image 都选择了这条路。

- Prompt Enhancer 成为标配组件:自动扩展用户输入的提示词,这个设计在 ERNIE-Image 上效果显著,可能会被更多模型借鉴。

总结

- ERNIE-Image 是百度开源的 8B 文生图模型,Apache-2.0 协议,商用友好。

- 在开源模型中,文字渲染能力最强,中英混排、排版准确度领先。

- 24GB 显存即可部署,消费级显卡友好。

- Turbo 版只需 8 步推理,速度领先。

- 适合海报设计、漫画创作、社交媒体素材等中文场景。